什么是sigmoid?

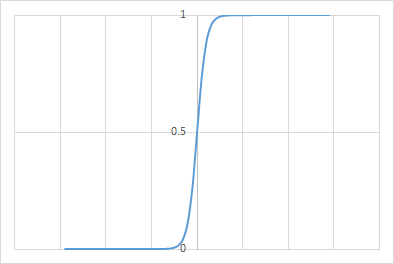

sigmoid就是一个函数,它的另一个名字也许你更熟悉--logistic函数:

在广义线性回归中,我们的hypothesis函数就是sigmoid函数.sigmoid函数是引入非线性最常见的手段.

所以在BP框架下的ANN(人工神经网络),最早是sigmoid+最小均方误差的一个配合,优化求解方法是梯度下降。

为什么使用它:

- 其可以将输入映射到0-1之间,以概率的形式表达

- 其是0均值的,中心对称的.

- 历史原因

- 因为其与高斯函数的积分形状很像.

由于我们大标题是从高斯说起,我们还是谈谈第四点,其实也是第一点.为何要用高斯函数的积分作为输出?

很显然,这时候我们的输入输出会是些什么呢?譬如身高x以下的概率,成绩为x及以下的概率,小球经过n次钉板的总偏移量为x以内的概率.都是合理的输入输出.

通过sigmoid的输出,我们可以将输入赋予一个类高斯积分形输出的解释(输入x的累计分布函数对应的值--概率)

所以它更适合做的是2分类,因为不需要考虑累积不累计了.输入的x对应是第一类的概率.